Sputnik Mundo yêu cầu chuyên gia về kỹ thuật robot từ Argentina ông Gonzalo Zabala, bình luận về nội dung này. Ai sẽ chịu trách nhiệm về những hành vi sai trái của robot, và hoạt động của các robot ảnh hưởng như thế nào đến cuộc sống của những người dân thường.

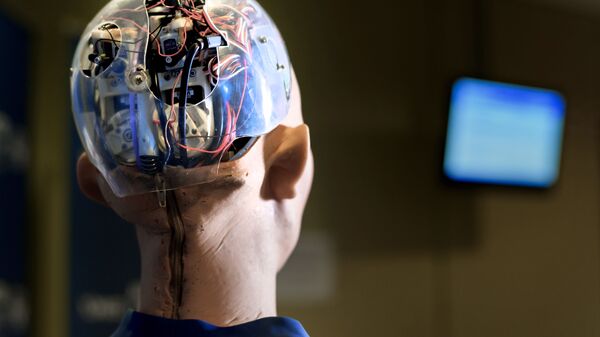

"Nếu người máy có khả năng tự đưa ra quyết định, các hành động này sẽ được đánh giá như thế nào từ quan điểm đạo đức? Ai sẽ chịu trách nhiệm về những quyết định sai trái mà người máy tự đưa ra? Các nhà khoa học đang tích cực nghiên cứu vấn đề này. Có cả nhóm luật sư phân tích những khía cạnh của vấn đề mới này ", — ông Gonzalo Zabala, chuyên gia về người máy từ Argentina, cho biết.

Hiện nay, các công ty phải chịu trách nhiệm. Nhưng, trí tuệ nhân tạo thường xuyên gia tăng khả năng của mình tự đưa ra quyết định, vì thế rõ ràng là trong pháp luật đã xuất hiện một khoảng trống.

Robot có thể học tập thông qua các thuật toán và dữ liệu có sẵn trên Internet, trên cơ sở đó robot sẽ có khả năng tự đưa ra quyết định dựa trên những kinh nghiệm của nó.

"Khi phát triển những hệ thống hoặc máy thông minh, chúng ta suy nghĩ về trí thông minh của con người, ví dụ như khả năng học tập. Nhiệm vụ này là rất hữu ích vì nó khiến chúng ta suy nghĩ về bản thân mình", — ông Zabala giải thích thêm.

Trí tuệ con người là "một hệ thống phức tạp", kiến trúc của nó khác hẳn với kiến trúc của máy tính. Nó hoạt động không phải với bit mà với hóa chất, không phải bằng kỹ thuật số mà bằng các hệ thống phi số (hay kỹ thuật tương tự analog). Khác biệt này tạo ra những tình huống "ngẫu nhiên" có thể được mô phỏng, nhưng không thể đạt được.

Theo chuyên gia Zabala, nguy cơ của trí tuệ nhân tạo được xác định bởi quy mô và phạm vi sử dụng nó.

"Trí thông minh nhân tạo và những công nghệ khác có thể tác động nghiêm trọng nhất đến nhân loại trong lĩnh vực công việc", — ông Zabala nói.

Tuy nhiên, theo ý kiến của ông Zabala, khó có thể dự đoán về một kịch bản tiêu cực nhất dẫn đến sự hình thành của một xã hội mà trong đó khái niệm về công việc sẽ biến mất.

"Các công nghệ tiên tiến đang được sử dụng không chỉ trong các tầng lớp thượng lưu của các nước "Thế giới thứ nhất". Trên khắp thế giới người dân không làm việc như họ đã làm 50 hoặc 100 năm trước đây", — chuyên gia cho biết.

Ông Zabala không coi robot là mối đe dọa đối với nhân loại. Ngược lại, chính "sự điên rồ của con người" trong xã hội tiêu dùng là mối đe dọa trong ngắn hạn.

"Chủ đề trí tuệ nhân tạo là một nội dung hấp dẫn trên các phương tiện truyền thông, còn vấn đề các nguồn tài nguyên bị đẩy xuống hàng thứ yếu. Tôi rất lo lắng về lập trường của Hoa Kỳ trong vấn đề Hiệp định khí hậu Paris. Và ngay cả ở các nước ủng hộ hiệp định này, mức sản xuất hàng tiêu dùng cũng rất cao", — ông Zabala kết luận.